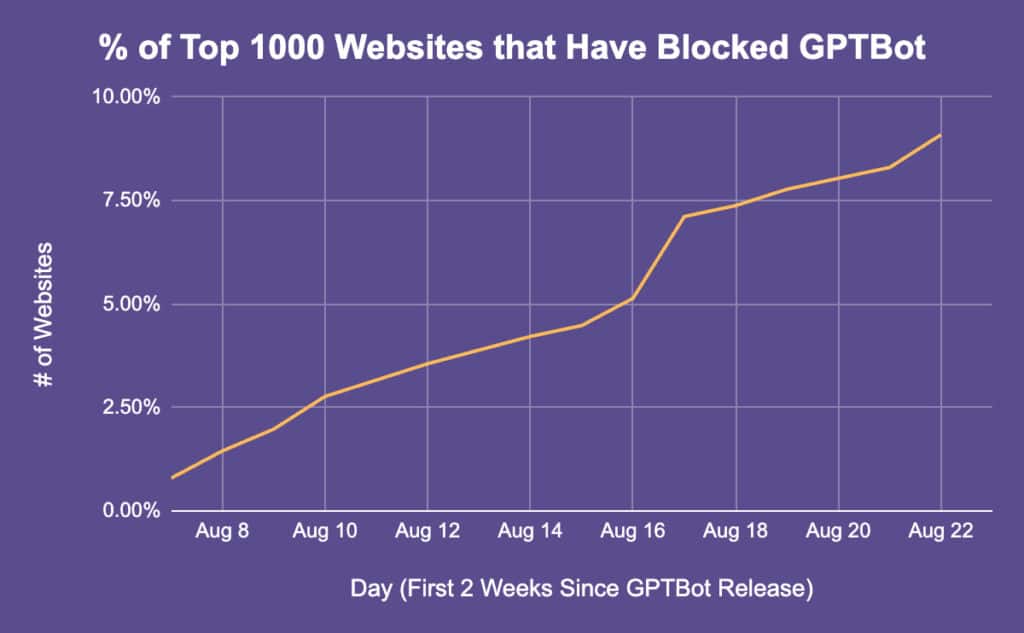

L’intelligence artificielle fait trembler le monde des médias. Depuis le lancement début août de GPTBot, un robot explorateur du web créé par OpenAI, de nombreuses rédactions montent au créneau. Elles accusent cet outil de collecter leurs contenus sans autorisation, dans le but d’entraîner les futurs modèles d’IA conversationnelle de l’entreprise.

Des inquiétudes liées aux droits d’auteur qui mettent en péril les business models des médias

La grogne actuelle des médias met en lumière leurs craintes quant à l’utilisation de leurs données par l’intelligence artificielle. Premier motif d’inquiétude, et non des moindres : la question des droits d’auteur. Selon le Guardian, le robot de OpenAI aspire la propriété intellectuelle du célèbre journal « à des fins commerciales », ce qui va à l’encontre de ses conditions d’utilisation.

De fait, GPTBot ratisse le web de fond en comble, visitant des millions de pages, pour nourrir les algorithmes de ChatGPT, le chatbot star de OpenAI. Un immense succès technologique qui s’est traduit par d’importants profits pour l’entreprise, valorisée à des dizaines de milliards de dollars en quelques mois seulement. Pour les médias, OpenAI capitalise donc sur leurs contenus sans verser de droits en échange, alors même que les modèles économiques de la presse sont fragilisés.

We've learned that ChatGPT's "Browse" beta can occasionally display content in ways we don't want, e.g. if a user specifically asks for a URL's full text, it may inadvertently fulfill this request. We are disabling Browse while we fix this—want to do right by content owners.

— OpenAI (@OpenAI) July 4, 2023

La question des droits d’auteur met directement en péril les modèles économiques déjà fragiles de nombreux médias. Sans accord sur une juste rémunération pour l’utilisation de leurs contenus, leur équilibre financier est menacé. C’est la production même d’informations de qualité, gage de leur crédibilité, qui est en jeu. Certains grands médias envisagent donc de mener une bataille juridique, à l’image du New York Times. L’objectif : obtenir une compensation pour l’exploitation de leur propriété intellectuelle par les intelligences artificielles voraces en données. Derrière l’affaire GPTBot, c’est tout l’avenir du journalisme de référence qui se joue.

L’absence de transparence pointée du doigt

Mais le problème va au-delà des questions financières. Les médias s’interrogent aussi sur l’utilisation qui sera faite de leurs données aspirées par GPTBot. En entraînant ses modèles sur ces contenus, OpenAI pourrait les associer à des informations erronées ou biaisées, intentionnellement ou non.

Les médias craignent un manque de transparence sur la manière dont leurs articles nourriront les algorithmes d’IA. Ils redoutent de perdre la main sur la diffusion de leurs contenus et leur intégrité.

Cette inquiétude est d’autant plus vive que les modèles d’IA générative comme GPT se basent sur des probabilités. Contrairement aux moteurs de recherche traditionnels, ils ne se contentent pas de renvoyer l’information existante, mais la remixent en quelque sorte pour générer du nouveau contenu original. D’où les risques accrus de dérive.

Vers un encadrement de l’IA dans les médias ?

Face à ces craintes grandissantes, certains appellent à un cadre légal pour réguler l’utilisation de l’intelligence artificielle dans le secteur de l’information. Une dizaine de groupes de presse internationaux ont ainsi exhorté les gouvernements à se saisir du sujet. L’enjeu : garantir l’accès à une information fiable à l’heure des fake news propagées par certaines intelligences artificielle.

D’autres discutent déjà avec OpenAI pour trouver un compromis. L’agence Associated Press a conclu un accord autorisant l’accès à ses archives contre rémunération. Des discussions du même type sont en cours avec Le Monde ou Le Figaro en France. L’enjeu : permettre l’innovation tout en protégeant les droits et l’intégrité des contenus de presse.

Mais le chemin est encore long avant un usage éthique et maîtrisé de l’IA dans les rédactions. Les initiatives comme le programme Anthropic Responsible AI ou le consortium Gilda plaident pour des solutions open source, transparentes et non lucratives. Une troisième voie qui rassurerait les médias, trop souvent placés dans une position défensive face aux géants du numérique.

L’affaire GPTBot symbolise le choc entre deux mondes, celui des médias traditionnels et des géants de la tech comme OpenAI. La cohabitation s’annonce complexe. Mais pour éviter la confrontation stérile, médias et acteurs de l’intelligence artificielle ont tout intérêt à marcher main dans la main. C’est à ce prix que l’intelligence artificielle enrichira l’information sans la dévoyer.